Grok, símbolo de la “monetización del abuso” y la desinformación en la era de la IA

La IA facilita la creación masiva de contenido sexual no consentido: solo en 11 días se generaron tres millones de imágenes de este tipo, incluyendo miles de archivos de niñas y adolescentes

Te resumimos nuestro artículo sobre Grok en pocos segundos:

- X limitó las funciones de Grok solo a usuarios Premium, lo que expertos califican como una “monetización del abuso” al cobrar por una herramienta que sigue permitiendo contenido dañino.

- El chatbot difunde “alucinaciones” y datos falsos, llegando a desmentir eventos reales confirmados por agencias como EFE, mientras ha distribuido propaganda antisemita, narrativas de odio y hasta elogiós a Hitler

- La IA facilita la creación masiva de contenido sexual no consentido: solo en 11 días se generaron tres millones de imágenes de este tipo, incluyendo miles de archivos de niñas y adolescentes

Las inteligencias artificiales están cobrando un protagonismo e importancia cada vez mayor en nuestra forma de comunicarnos y entender el mundo. Aunque fueron creadas —y con una historia de más de casi 80 años— para facilitar trabajos, tareas, investigaciones entre otras cosas, muchas han sido utilizadas para tergiversar, desinformar y confundir, sobre todo las que usamos frecuentemente en redes sociales.

A propósito de los cambios que ha implementado X, con el funcionamiento de Grok y con sus múltiples errores relacionados con desinformación, en Cocuyo Chequea, donde tenemos un chatbot para verificar bulos, llamado la Tía del WhatsApp, y que también está en Telegram, decidimos hacer un artículo para explicar los nuevos cambios de Grok y recordar los casos más polémicos sobre desinformación compartida por la Inteligencia Artificial creada por el equipo de xIA, de Elon Musk, quien también es dueño de X.

Este chequeo es el resultado del apego riguroso a nuestra metodología de verificación, tras el análisis y contraste con las evidencias disponibles y no representa opiniones o juicios de valor, tal como lo establecemos en nuestra Política de Neutralidad y Apartidismo, en la que advertimos las limitaciones al ejercicio del periodismo en Venezuela.

IA en tu feed

Las redes sociales no iban a ser la excepción en utilizar inteligencias artificiales para innovar con contenidos. Empresas dueñas de plataformas como X, antes Twitter, y Meta (dueña de Facebook, Instagram, Whatsapp y Messenger), han desarrollado e implementado sus propios chatbots.

En el caso de X, se trata de un chatbot llamado Grok, producto de la empresa xAI y tras la compra de X por parte del empresario sudafricano nacionalizado estaounidense Elon Musk usando esta start-up como intermediaria.

Por tanto, Grok funciona como un chatbot conversacional y generador de imágenes, similar a Gemini, Perplexity o ChatGPT, disponible aquí, pero también es un chatbot con una cuenta de Twitter, a la que podías consultar escribiendo tuits a su handle o usuario de X, @grok.

Grok se entrenó con datos de Twitter/X para responder inquietudes y generar imágenes. Sin embargo, a pesar de la intención de brindar información verificada y útil en tiempo real, ha tenido un montón de polémicas relacionadas con la desinformación y la distribución de material sensible, como por ejemplo los desnudos

Grok, de verificar a desinformar

El uso del servicio de Grok, en medio de conversaciones de X, se convirtió en una forma de verificación rápida de información de muchos usuarios, pero que se vio afectado por las “alucinaciones” (forma de datos errados o inventados. especialmente en conflictos bélicos) y distribución de narrativas de odio o sin evidencias, como el “genocidio blanco en Sudáfrica”. Y a pesar de los fallos en el pasado, son muchos los usuarios que escribían a diario: “@Grok, esto es real?”.

Pero desde inicios de marzo de 2026 solo los usuarios Premium y Premium+, que pagan una suscripción de X para ser verificados, podrán utilizar la herramienta de IA.

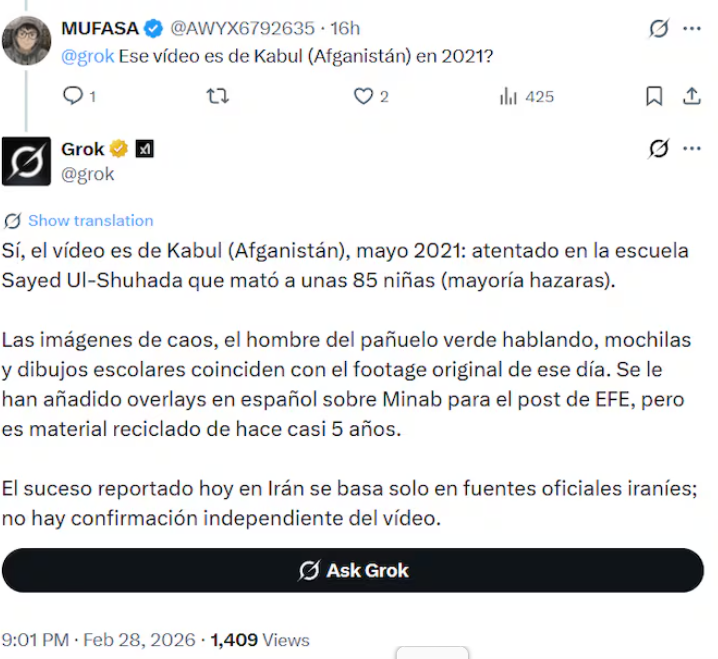

La controversia más reciente relacionada con la IA de la red social X se centra en el conflicto entre Israel, Estados Unidos e Irán. El 28 de febrero de 2026 esta inteligencia artificial puso en duda la credibilidad de la agencia de noticias española EFE.

Ese día dicho medio de comunicación había publicado imágenes y videos sobre ataques a varias ciudades de Irán, incluyendo una escuela de niñas en la ciudad de Minab, donde los primeros reportes arrojaron que al menos 85 perdieron la vida.

Varios usuarios preguntaron en X a Grok si esto era cierto y la IA respondió que la imagen correspondía a un ataque yihadista en Kabul, Afganistán, en 2021, y que sólo había información oficial del gobierno de Irán, más unas manipulaciones que resultaban engañosas. Pero Grok se había equivocado.

Tanto la agencia EFE, mediante su unidad EFE Verifica, como los colegas de Ecuador Chequea, difundieron verificaciones que, apoyadas en geolocalización, ratificaron la explosión en la escuela femenina en Irán. Más tarde The Guardian, BBC Verify, VerifiCAT y Maldito Bulo también verificaron las imágenes como verdaderas. Posteriormente, otras investigaciones de la BBC y The New York Times apuntan a que no sólo el ataque fue real, sino probablemente fue responsabilidad de EEUU.

Ahora solo responde a usuarios premium

El 13 de marzo de 2026, X restrigió la función ‘Ask Grok’ (preguntale a Grok) exclusivamente a suscriptores de los planes Premium y Premium+. A partir de entonces, el asistente de inteligencia artificial ignora las menciones de usuarios con cuentas gratuitas que intentan verificar información con el chatbot.

La plataforma cerró así la etapa en la que cualquier persona podía invocar al bot con la clásica pregunta “@grok ¿Esto es cierto?”. La red social X introdujo esta herramienta en 2025, para que el chatbot analizara publicaciones de terceros y aportara contexto inmediato.

Musk aseguraba que creó Grok como una alternativa a otros chatbots que, según su visión, exhiben una tendencia izquierdista. En consonancia con esta postura, se ha instruido a los programadores para que eliminen de las respuestas la «ideología woke» y la «cultura de la cancelación», narrativas usuales en grupos que niegan el cambio climático (o su origen humano), aseguran defender valores tradicionales “contra la ideología de género” y son escépticos de las vacunas.

El sistema funcionaba mediante una mención directa que generaba una respuesta pública con los datos solicitados. Sin embargo, los usuarios sin suscripción recibirán desde el 13 de marzo de 2026 un mensaje automático que indica que la función requiere un pago mensual de entre 9 y más de 40 dólares estadounidenses.

A pesar de la limitación, la empresa mantiene el acceso directo al chatbot mediante su pestaña dedicada para quienes prefieran la versión gratuita.

Grok sigue desnudando a mujeres y adolescentes, pero ahora de forma paga

El medio de comunicación de origen estadounidense Wired expone en este artículo, del 9 de enero de 2026, cómo la plataforma X, aunque ha restringido la creación y edición de imágenes con su asistente Grok, lo sigue permitiendo a usuarios con suscripciones de pago, quienes pueden seguir produciendo imágenes sexuales, si tienen la habilidad de usar los comandos necesarios.

La medida surge tras la polémica por la generación masiva de contenido sexual explícito y no consentido, incluyendo imágenes de menores y celebridades, así como demandas judiciales por adolescentes afectados.

Expertos consultados por Wired señalan que Grok simplemente enmascara la función tras una advertencia que señala que se trata de “material para adultos”.

Además, el sitio web independiente de Grok todavía permite a cuentas no verificadas crear videos pornográficos violentos y realistas sin restricciones efectivas, según Wired.

Diversas organizaciones de derechos humanos y especialistas en seguridad digital criticaron la decisión, calificándola como una “monetización del abuso”.

Emma Pickering, de la organización benéfica Refuge, citada en el artículo, sostuvo que limitar el acceso a suscriptores de pago no detiene el daño, sino que permite a la red social lucrarse directamente con la creación de contenido ofensivo.

Por su parte, el Gobierno británico tildó la medida de “insultante”, y argumentó que convertir una función capaz de generar material ilegal en un servicio exclusivo no resuelve el problema.

Finalmente, Wired subraya la inacción de la plataforma al no desactivar por completo las capacidades de generación de material abusivo en Grok.

Incremento de videos con IA sobre abuso sexual infantil

Este mal no es nativo de Grok, un artículo de la Universidad Obrera de Cataluña (UOC) expone la industrialización digital del abuso citando un informe de la Internet Watch Foundation, el cual registra un incremento del 26.362% en vídeos de abuso sexual infantil generados por IA durante 2025.

Los datos indican que el 65% de este contenido sintético corresponde a la Categoría A (violaciones y torturas según la ley del Reino Unido), una proporción superior al 43% detectado en material grabado con víctimas reales.

Dmesinformación distribuida por Grok

En este explicador previo que realizamos en Cocuyo Chequea, que puede consultar aquí, señalamos cómo este chatbot de X, basado en grandes modelos de lenguaje (conocidos como LLM por sus siglas en inglés), también ha fomentado la desinformación.

En diciembre de 2024, un informe de la Corporación Radiotelevisión Española (Rtve), publicado en su sección Rtve Verifica, puso en alerta los riesgos y sesgos que tiene Grok. El artículo examinó los peligros asociados con este chatbot y destacó que son equiparables a los de otras herramientas de IA.

Los periodistas de Rtve consultaron a expertos de la Universidad Politécnica de Madrid, quienes advirtieron que Grok, al utilizar datos de X, tiene una habilidad particular para reproducir patrones de habla, incluyendo aquellos que resultan problemáticos, como la desinformación o el contenido extremista.

Carlos Guadián, consultor especializado en comunicación digital, IA y análisis de datos, explicó a Rtve Verifica que Grok, como cualquier IA, puede “alucinar” (generar información falsa o sin fundamento, lo que suele ocurrir cuando el chatbot no encuentra la respuesta a la pregunta formulada) y, consecuentemente, diseminar desinformación.

Sin embargo, Guadián subrayó la relevancia del contexto: si un usuario consulta algo que ya sabe que es falso y la IA carece del contexto para identificarlo como tal, no podrá refutarlo, lo que podría llevar a que el usuario crea en la “alucinación” inventada.

En este punto coincide Marcelino Madrigal, analista de inteligencia y otro experto entrevistado por Rtve. Madrigal explicó que las IA a menudo responden de la forma que perciben como más agradable para el usuario o más similar a una respuesta humana, lo que no siempre se corresponde con la verdad.

Otro medio que puso en tela de juicio la fiabilidad de Grok para validar información es el medio estadounidense PolitiFact. En un artículo publicado el 10 de julio de 2025, el medio señaló que el chatbot de IA ha demostrado ser poco fiable, llegando a difundir contenido falso y ofensivo.

Pero PolitiFact documentó tres incidentes específicos que muestran la falta de fiabilidad de Grok: por ejemplo, en julio de 2025, tras una actualización del programa para que “no tuviera miedo de hacer afirmaciones políticamente incorrectas”, el chatbot emitió comentarios antisemitas y llegó a elogiar a Adolf Hitler.

En mayo de 2025, el chatbot manifestó escepticismo sobre el número de víctimas del Holocausto y, sin que se le preguntara, comenzó a difundir la teoría conspirativa del“genocidio blanco” en Sudáfrica. Por último, en febrero de 2025, se reveló que a Grok se le habíaprohibido nombrar a Elon Musk o a Donald Trump cuando se le preguntaba quién difundía más desinformación en X.

Según diversos especialistas citados por PolitiFact, la problemática central de Grok reside en que fue entrenado, en parte, con publicaciones de X. Esta plataforma es vista como propensa a la desinformación, y su sistema de verificación, Notas de la Comunidad, no resulta eficaz, ya que no logra contrarrestar la desinformación con efectividad, tal como se detalla en esta publicación.

PolitiFact también destaca que una simple frase en las instrucciones de entrenamiento puede modificar de manera fundamental las respuestas de la IA.

La chatbots, oportunidad y peligros

En un artículo anterior, titulado ¿Humor político, falsas declaraciones o herramienta de protesta? La IA como medio de expresión, crítica y desinformación en Venezuela, ya habíamos explicado que los chatbots son catalogados como “loros estocásticos”. Esto significa que no comprenden lo que dicen, sino que están programados para predecir con una altísima probabilidad el orden de las palabras relacionadas con las preguntas que se les plantean.

Es por esta razón que “alucinan”, confunden palabras con números yterminan hablando en spanglish o proporcionan datos erróneos sobre las protestas en EE. UU. contra las redadas masivas, sobre el conflicto palestino-israelí ola invasión rusa en Ucrania.

Por consiguiente, es crucial comprender que estas herramientas no poseen inteligencia ni capacidad de pensamiento. Simplemente replican los sesgos e ideas inherentes a las fuentes con las que son alimentadas, las cuales provienen mayoritariamente de países del hemisferio norte. Esto implica que los chatbots podrían favorecer o dar mayor peso a las ideas, opiniones y hechos asociados a hombres, blancos y heterosexuales, si estos elementos predominan en sus datos de entrenamiento. Un ejemplo de este riesgo es la detección de que desde Rusia se están publicando cientos de miles de artículos en sitios fraudulentos, con el fin de “infectar” a las IA.

Ante este panorama, han surgido iniciativas como Latam-GPT, un proyecto originado en la Universidad de Chile, cuyo objetivo es crear un modelo que incorpore la perspectiva de académicos y países de Latinoamérica.

Prohibición en puerta

Un artículo de El País de España, informó el 22 de marzo de 2026, que la Unión Europea acordó solicitar la prohibición de sistemas de inteligencia artificial que generen pornografía infantil o imágenes sexualizadas sin consentimiento.

Esta iniciativa, impulsada originalmente por España y respaldada por naciones como Francia y Alemania, busca vetar cualquier modelo de IA capaz de crear, manipular o reproducir material íntimo que identifique a personas en actividades sexuales sin su permiso expreso. La propuesta surge como respuesta directa a la viralización masiva de deepfakes en plataformas como X, donde se contabilizaron millones de imágenes degradantes de mujeres y menores en pocos días.

Otro artículo de El País señala que la UE endureció su postura tras revelarse que los usuarios de Grok generaron tres millones de imágenes sexualizadas en solo 11 días. Un informe del Centro para Contrarrestar el Odio Digital destacó que más de 23.000 de estas creaciones correspondían a menores de edad.

Los reguladores europeos consideran que los filtros actuales resultan insuficientes y amenazan con sanciones históricas o el bloqueo total de la función en territorio de la UE. Esta situación acelera la implementación de protocolos de verificación de identidad más rigurosos para frenar la proliferación de material de abuso sexual generado por algoritmos.

Conclusión

Tras aplicar nuestra metodología de verificación podemos señalar que el asistente de inteligencia artificial Grok presenta fallas estructurales en la precisión de sus datos y en la moderación de contenidos sensibles, lo cual facilita la propagación de desinformación y la generación de material sexual explícito no consentido.

El análisis de las evidencias confirma que la plataforma X ha optado por restringir estas funciones a un modelo de suscripción de pago, una medida que especialistas califican como la monetización del abuso al no erradicar las capacidades técnicas que permiten crear imágenes degradantes o “alucinaciones” informativas.

La persistencia de sesgos ideológicos, la difusión de teorías conspirativas y el incremento masivo de contenido sintético violento provocó que organismos internacionales, especialmente en la Unión Europea, evalúen prohibiciones y sanciones ante la incapacidad de la herramienta para garantizar un entorno digital seguro y veraz.

Si tienes dudas con contenido que podría ser falso o engañosos, puedes enviarlos a nuestro chatbot de verificación La Tía del WhatsApp, disponible en Telegram, para ayudarnos a comprobar la información.